- 防止 PII(个人身份信息)泄露

- 检测和阻止提示注入攻击

- 阻止不适当或有害的内容

- 执行业务规则和合规要求

- 验证输出质量和准确性

确定性防护栏

使用基于规则的逻辑,如正则表达式模式、关键字匹配或显式检查。快速、可预测且经济高效,但可能会遗漏细微的违规行为。

基于模型的防护栏

使用 LLM 或分类器通过语义理解来评估内容。捕获规则遗漏的细微问题,但速度较慢且成本更高。

内置防护栏

PII 检测

LangChain 提供内置中间件,用于检测和处理对话中的个人身份信息(PII)。此中间件可以检测常见的 PII 类型,如电子邮件、信用卡、IP 地址等。 PII 检测中间件适用于以下情况:具有合规要求的医疗和金融应用程序、需要清理日志的客户服务代理,以及通常处理敏感用户数据的任何应用程序。 PII 中间件支持多种处理检测到的 PII 的策略:| 策略 | 描述 | 示例 |

|---|---|---|

redact | 替换为 [REDACTED_{PII_TYPE}] | [REDACTED_EMAIL] |

mask | 部分隐藏(例如最后 4 位数字) | ****-****-****-1234 |

hash | 替换为确定性哈希 | a8f5f167... |

block | 检测到时抛出异常 | 抛出错误 |

内置 PII 类型和配置

内置 PII 类型和配置

内置 PII 类型:

email- 电子邮件地址credit_card- 信用卡号码(经过 Luhn 验证)ip- IP 地址mac_address- MAC 地址url- URL

| 参数 | 描述 | 默认值 |

|---|---|---|

pii_type | 要检测的 PII 类型(内置或自定义) | 必需 |

strategy | 如何处理检测到的 PII("block"、"redact"、"mask"、"hash") | "redact" |

detector | 自定义检测器函数或正则表达式模式 | None(使用内置) |

apply_to_input | 在模型调用之前检查用户消息 | True |

apply_to_output | 在模型调用之后检查 AI 消息 | False |

apply_to_tool_results | 在执行之后检查工具结果消息 | False |

人工介入

LangChain 提供内置中间件,用于在执行敏感操作之前需要人工批准。这是对高风险决策最有效的防护栏之一。 人工介入中间件适用于以下情况:金融交易和转账、删除或修改生产数据、向外部方发送通信,以及任何具有重大业务影响的操作。自定义防护栏

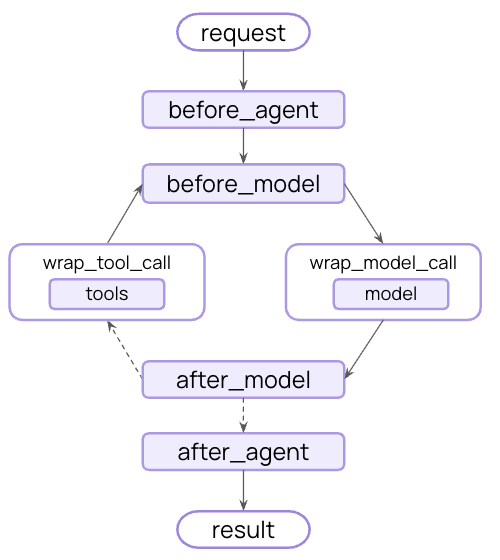

对于更复杂的防护栏,您可以创建在代理执行之前或之后运行的自定义中间件。这使您可以完全控制验证逻辑、内容过滤和安全检查。代理前防护栏

使用”代理前”钩子在每次调用的开始时验证一次请求。这对于会话级检查很有用,如身份验证、速率限制或在任何处理开始之前阻止不适当的请求。代理后防护栏

使用”代理后”钩子在返回用户之前一次性验证最终输出。这对于基于模型的安全性检查、质量验证或对完整代理响应的最终合规扫描很有用。组合多个防护栏

您可以通过将多个防护栏添加到中间件数组来堆叠它们。它们按顺序执行,允许您构建分层保护:其他资源

- 中间件文档 - 自定义中间件的完整指南

- 中间件 API 参考 - 自定义中间件的完整指南

- 人工介入 - 为敏感操作添加人工审核

- 测试代理 - 测试安全机制的策略